GAIA est un nouveau benchmark conçu pour évaluer la capacité réelle des intelligences artificielles à raisonner comme des humains en testant leur intelligence pratique et multimodale.

Créé par des chercheurs de Meta-FAIR, Meta-GenAI, HuggingFace et AutoGPT, il se compose de 466 questions couvrant un large éventail de tâches : logique, calculs, recherche d’informations, analyses multi‑sources, etc.

GAIA met l’accent sur des questions conceptuellement simples pour les humains, mais souvent difficiles pour les IA avancées comme :

- Le raisonnement : faire des déductions logiques à partir d’informations données

- La gestion multimodale : interpréter des textes, images, tableaux ou autres formats

- La navigation sur le web : chercher des informations en ligne

- L’utilisation d’outils : savoir quand et comment utiliser des ressources externes

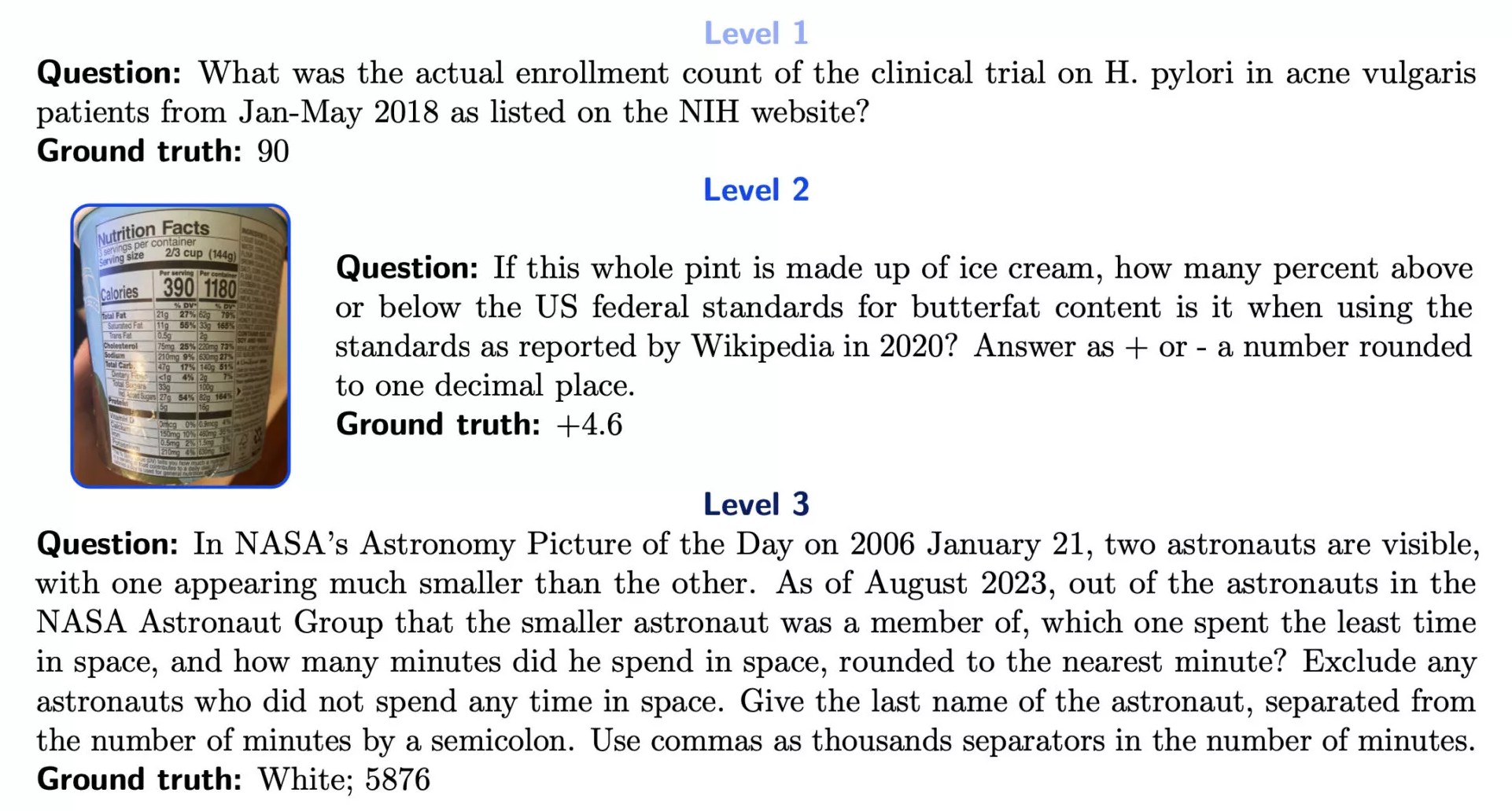

Organisation du benchmark GAIA

Le benchmark est organisé en trois niveaux de difficulté

- Niveau 1 : Questions accessibles aux meilleurs modèles de langage (LLM) avec un bon raisonnement

- exemple : quel était le nombre réel d’inscriptions à l’essai clinique sur H. pylori chez les patients atteints d’acné vulgaire entre janvier et mai 2018, tel qu’indiqué sur le site Web du NIH ?

- Niveau 2 : Tâches nécessitant plus de étapes ou d’outils

- exemple : si cette pinte entière est composée de crème glacée, de combien de pourcentages supérieure ou inférieure aux normes fédérales américaines pour la teneur en matières grasses du beurre se situe-t-elle, en utilisant les normes telles que rapportées par Wikipedia en 2020 ? Répondez par + ou – un nombre arrondi à une décimale

- Niveau 3 : Problèmes complexes indiquant un saut significatif dans les capacités de l’IA

- exemple : dans l’Astronomy Picture of the Day de la NASA du 21 janvier 2006, deux astronautes sont visibles, l’un apparaissant beaucoup plus petit que l’autre. En août 2023, parmi les astronautes du groupe de la NASA dont faisait partie l’astronaute plus petit, lequel a passé le moins de temps dans l’espace, et combien de minutes a-t-il passé dans l’espace, arrondi à la minute la plus proche ? Excluez les astronautes qui n’ont passé aucun temps dans l’espace. Donnez le nom de famille de l’astronaute, séparé du nombre de minutes par un point-virgule. Utilisez des virgules comme séparateurs de milliers dans le nombre.

Les IA sont loin des capacités de raisonnement humain

Les premiers résultats montrent un écart majeur entre humains et IA :

- Un humain réussit 92 % des questions,

- GPT‑4 n’en réussit que 15 % (ou 30 % pour les plus simples).

Ces performances démontrent que les IA, malgré leurs apparences sophistiquées, restent limitées : elles imitent le comportement humain sans posséder de véritable logique ni capacité fiable à croiser plusieurs sources.

GAIA sert principalement à mesurer les progrès des modèles et à aider les chercheurs à améliorer leurs systèmes, dans l’espoir de développer un jour des IA capables d’un raisonnement plus proche de l’humain. Le benchmark a néanmoins des limites, notamment son usage exclusif de l’anglais et le fait qu’il ne tient pas compte des étapes de raisonnement utilisées par les modèles.

En résumé : les IA sont encore loin de remplacer l’humain, et GAIA illustre clairement l’ampleur du chemin restant.

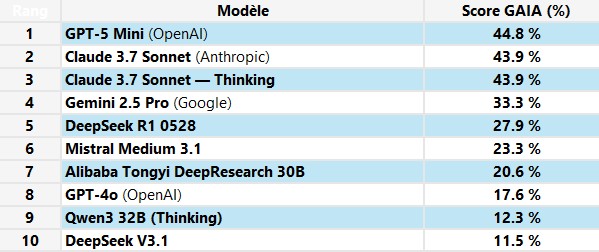

Classement GAIA des meilleurs modèles

Selon la source LayerLens / PricePerToken (7 mars 2026), voici les top modèles évalués directement sur GAIA, sans orchestrations multi‑agents complexes :

Les scores restent globalement faibles comparés aux capacités humaines (92 %), mais OpenAI et Anthropic dominent clairement.

Quelques exemples de questions